告別Token焦慮!Anthropic提供4個有效降低Claude Code成本祕訣!

近期Claude AI用戶最關心的,應該就是Token消耗速度過快、完全不夠用的問題,不少人反映,明明只進行了幾個簡單操作,卻在短時間內吃掉大量配額,到底該怎麼辦?對此Anthropic官方提供一些解決方案。

文/《104職場力》

本文導覽

為什麼有些人的Token燒得特別快?

先理解Token消耗的本質,簡單說就是:用戶傳給Claude處理的資訊越多,每次互動就會消耗越多Token。

多數「燒得特別快」的情況,其實來自幾種非常消耗額度的使用模式,比如:

- 選了不適當的模型

- 過度使用運算密集功能

- 反覆讀取巨大且陳舊的上下文

- 不清楚的提示詞設計

理解背後邏輯後,接下來看官方給出了什麼解決方案。

Anthropic官方提出降低Token消耗的4大建議

根據Claude Code 負責人Lydia Hallie在社群發表的官方說明,Anthropic對此現象給出了以下4項核心建議:

1.選擇適合的模型:Sonnet優於Opus

高階的Opus模型Token消耗數量大約是Sonnet的兩倍,如果你的問題不需要高強度或深度的推理能力,其實Sonnet就夠用了,沒有必要全程使用Opus。

補充Claude各模型Token成本消耗量:

- 簡單任務可使用Haiku(Token成本最低)

- 一般編碼和輔助可用Sonnet(成本效益最優)

- 複雜推理和架構設計再使用Opus(最高能力,但Token成本也最高)

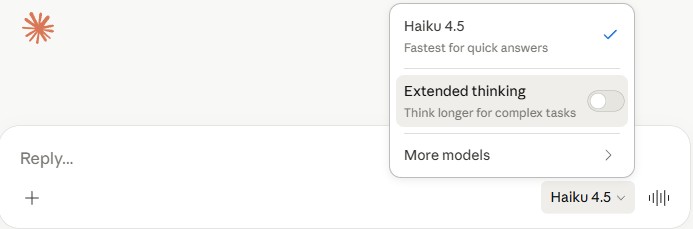

2.調降運算強度或關閉「延伸思考」功能

Claude Code運算強度(Effort Level)或「延伸思考(Extended Thinking)」功能都會加深模型推理的步驟跟深度,建議如果只是請AI執行較簡易的任務,可以調降或關閉功能,減少Token的使用量。

3.累積太多資訊並閒置太久,請重開新對話框

當你跟AI已經聊到一個程度,累積了大量的上下文內容,且這個工作階段(Session)已經閒置約1小時以上,建議下次直接開啟新的工作階段,不要用同一個,避免模型因為要重新處理這些大量資訊,直接燒光Token。

4.設定視窗上限控制對話長度

Claude Code可以透過環境變數參數設定「CLAUDE_CODE_AUTO_COMPACT_WINDOW=200000」自動壓縮過長的上下文,白話來說就像告訴它「當對話內容超過這個長度時,請自動幫我精簡重點,把舊的細節丟掉」,如此一來可以避免每次互動時AI都要讀取歷史紀錄,浪費Token。

除了上述建議,也可以參考Claude官方文件,裡面有更詳細的說明;Lydia Hallie最後在貼文中提到,團隊不只積極修復Bug,還會陸續推出效率優化的項目,同時在產品內加入彈出視窗,避免使用者誤觸大型提示快取失誤;另也呼籲用戶確保自己使用的是最新版本,以提升體驗跟效率。

(參考資料來源:Lydia Hallie X)